真実はその技術です あなたは常に開発者の創意工夫が必要になります 最も複雑な問題を解決します。 Pixelのポートレートモードを最適化するためのそのソリューションは、5台のカメラを備えた特別なケースでGoogleから提供されました。

今、あなたはなぜだろうか 5つのケースでXNUMX台のカメラがすべて一緒に必要です 描写された人物の顔だけを取り、シーンの残りの部分に焦点を合わせないことであるかもしれない問題の解決策を見つけるために。 それがグーグルとそのブログが私たちに一連の説明を与えるためのものです。

Pixel3の印象的なポートレートモード

Pixel 2では、ビッグGがモバイルデバイスからの写真撮影の分野で質的な飛躍を遂げました。 単に 私たちは彼がどのようにできたかに驚いていました、ソフトウェアから、描写されたものの顔以外のすべてが見事にぼやけるようにシーンを分析できるようにします。

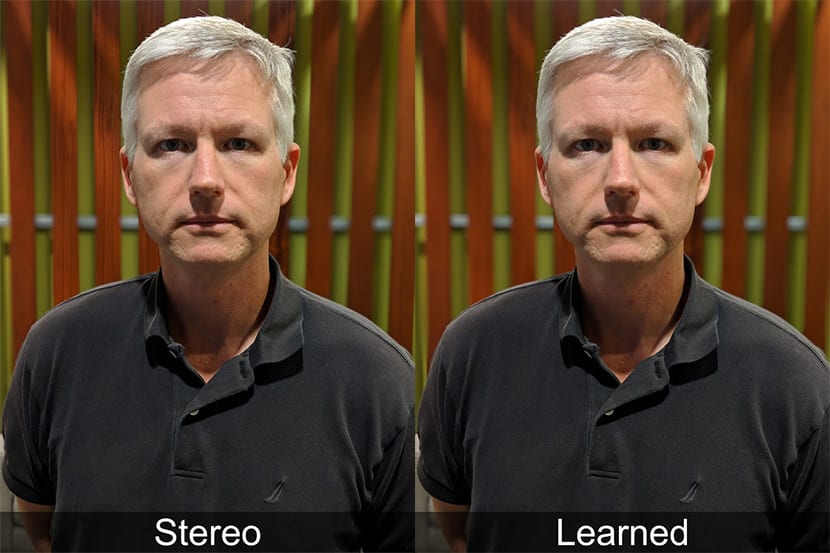

Pixel3の場合も その技術を改善するために独自の方法で働いてきました Pixel 2にもたらされたものと比較して、品質がわずかに飛躍しました。面白いことに、同時に興味深いのは、Pixel 3では、5台のPixelスマートフォンのフランケスタインケースと呼ばれるものをXNUMXつに使用したことです。

彼はそのホルスターを使って 同じシーンを同時に5ショット したがって、ポートレートモードを改善することができます(示されているように) この投稿で優れた結果が得られました) 優れた Pixel 3。彼のエキサイティングな夜景や、 Pixel2で使用できるスーパーズーム).

GoogleがPixel3のポートレートモードをどのように改善したか

Pixel 2は、PDAF(Phase Detection Autofocus)テクノロジーに大きく依存していました。 被写界深度から基本情報を収集する、彼が焦点を合わせていたXNUMXつのPDAFアパーチャを通して。 このシステムの唯一の欠点は、それが完全に完璧ではなかったことです。 大量の水平線が共存する特定のシーンでは、これらのPDAF画像の比較を処理して深度を決定する「システム」が混乱する可能性があります。

私たちの理解では、PDAFアパーチャの線形構成と一致する視覚要素は、偽陰性になる可能性があります。 何がそれを得たのか 写真にとって重要なコンテンツ 実際よりもカメラに近いように見えました。

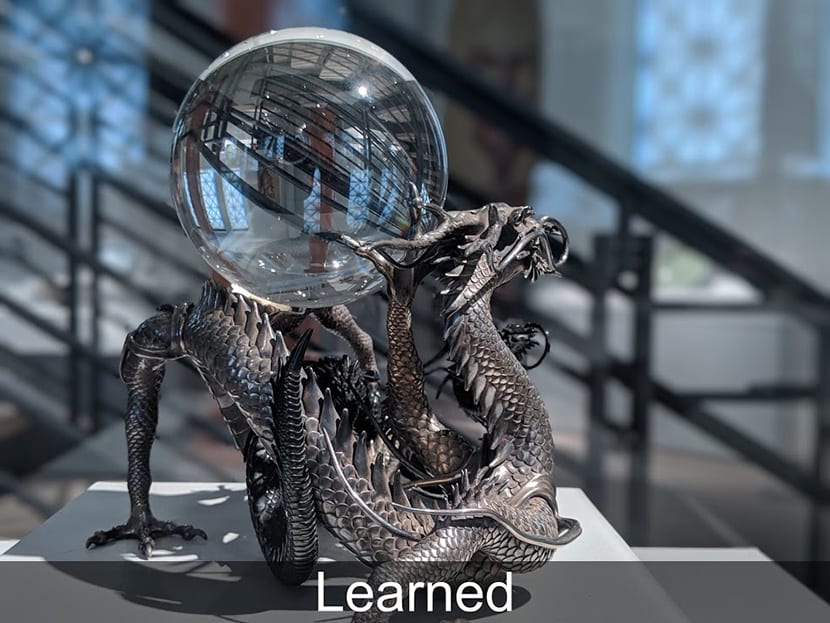

Googleが使用するデータを追加することで解決策が見つかったのはPixel3です。 セマンティックとぼかしの手がかりとして呼ばれています。 写真を見て、オブジェクトの相対的なサイズとそのぼかしを知ることができるときに、私たち全員に何ができるかを考えてみましょう。

思ったほど簡単ではない

しかし、すべてを完璧にするために、Googleはしなければなりませんでした フランケンシュタイン事件と呼ばれるもので技術を訓練する それらの5ピクセルで。 これにより、XNUMXつの異なる角度から同時にキャプチャを行うことが可能になりました。

これにより、画像のソースが同じタイプのハードウェア、つまりPixel 3からのものであり、これらの異なる視点がより多くのデータを提供して、PDAFアパーチャと同じ方向に収束するラインに落ちる問題を排除しようとします。 。。 とにかく、すべての問題が解決されたわけではありませんが はい、今では深さがより良い方法で決定されます より高い精度のために。

とともに そのケースとその5Pixel 3、Googleはニューラルネットワークをトレーニングすることができました これは、PAF«視差»データと以前の検出を組み合わせて、すべてのレベルでポートレートモードの精度を高める役割を果たします。 ポートレートモードのテクノロジーにおけるこの改善のもうXNUMXつのハイライトは、キャプチャ内のすべての深度データがこのモードで保存されるため、開発者が利用できる新しい機能がウィンドウに表示されることです。