Ciekawostką jest to, że szereg badaczy Google Home, Siri i Alexa zostały zhakowane poprzez wyświetlanie światła laserowego W nich nie jest to sama wiadomość, która ma coś w sobie, ale nadal nie jest to pewne, ponieważ ci asystenci reagują na światło tak, jakby było dźwiękiem.

Rozmawiamy o tych trzech asystentów jest podatnych na ataki Cierpią z powodu laserów, które „wstrzykują” do urządzeń niesłyszalne, a czasem niewidzialne polecenia świetlne w celu odblokowania drzwi, odwiedzenia stron internetowych, a nawet zlokalizowania pojazdów.

Asystent, Siri i Alexa zhakowani

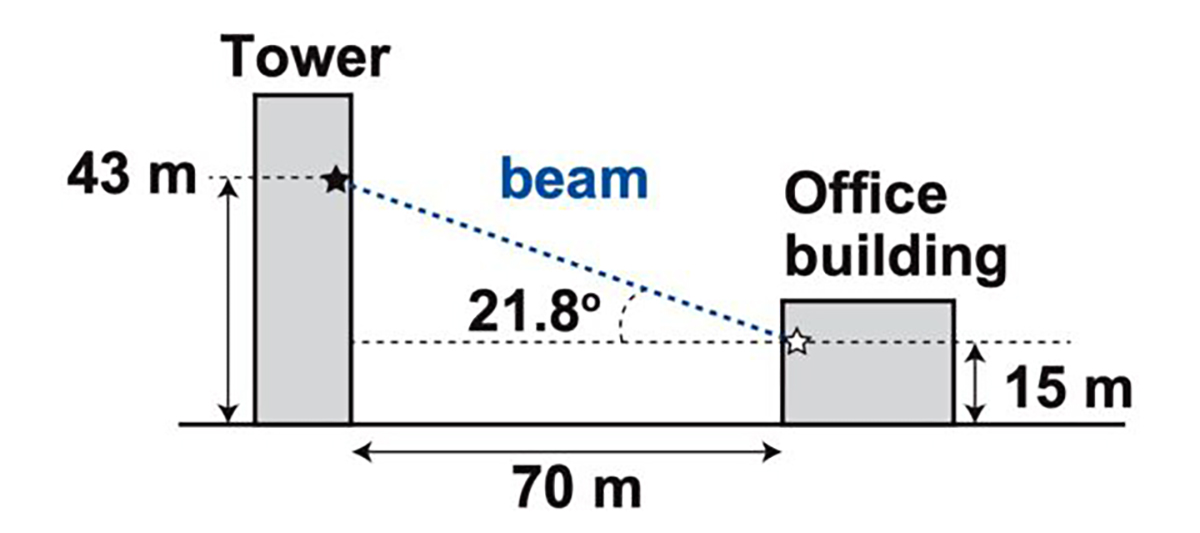

I to w odległości 110 metrów, z której można wyświetlaj światło lasera o niskiej częstotliwości, aby aktywować te systemy głosowe w którym „wstrzykuje się” polecenia, które następnie wykonują bardzo różnorodne działania. Badacze byli nawet w stanie wysyłać tego typu polecenia świetlne z jednego budynku do drugiego i przechodzić przez szybę, aby dotrzeć do urządzenia z Asystentem Google lub Siri.

O ile nam wiadomo, atak wykorzystuje istniejącą lukę w mikrofonach i nie tylko wykorzystuje tak zwane MEMS (układy mikroelektromechaniczne). Mikroskopijne elementy MEMS mimowolnie reagują na światło tak, jakby było dźwiękiem.

I choć badacze testowali tego typu ataki na Asystencie Google, Siri, Alexie, np nawet na portalu Facebook oraz małej serii tabletów i telefonówzaczynają wierzyć, że wszystkie urządzenia korzystające z mikrofonów MEMS są podatne na ataki tak zwanych „poleceń świetlnych”.

Nowa forma ataku

Tego typu ataki mają szereg ograniczeń. Pierwszym jest to Atakujący musi mieć bezpośrednie pole widzenia z urządzeniem ten, który chce zaatakować. Po drugie, światło musi być bardzo precyzyjnie skupione na bardzo konkretnej części mikrofonu. Należy również pamiętać, że jeśli atakujący nie użyje lasera na podczerwień, światło będzie łatwo widoczne dla każdej osoby znajdującej się w pobliżu urządzenia.

To, co odkryła ta seria badaczy, jest dość ważne z kilku powodów. Nie tylko ze względu na możliwość ataku na tę serię urządzeń sterowanych głosem, które zarządzają niektórymi ważnymi urządzeniami w domu, ale także pokazuje, w jaki sposób można przeprowadzać ataki w niemal rzeczywistych środowiskach.

To, co przyciąga wiele uwagi, to że przyczyna „fizyki” nie jest w pełni zrozumiała poleceń Light, które stają się częścią „exploitu” lub luki w zabezpieczeniach. Tak naprawdę, gdyby naprawdę było wiadomo, dlaczego tak się dzieje, oznaczałoby to większą kontrolę i obrażenia nad atakiem.

Uderzające jest również to, że ta seria urządzeń sterowanych głosem Nie noszą ze sobą żadnych wymagań dotyczących hasła ani kodu PIN. Oznacza to, że jeśli uda Ci się je „zhakować” tego typu emisją światła, możesz sterować całym domem, w którym Asystent Google lub Siri steruje oświetleniem, termostatem, zamykaniem drzwi i nie tylko. Prawie jak film.

Atak niskim kosztem

Możemy sobie wyobrazić, że posiadanie projektora laserowego może kosztować dużo. A przynajmniej koszt przeprowadzenia ataku w tym stylu był wysoki. Zupełnie nie. Jedna z konfiguracji ataku obejmuje koszt 390 dolarów wraz z zakupem wskaźnika laserowego, sterownika laserowego i wzmacniacza dźwięku. Jeśli jesteśmy większymi smakoszami, dorzucamy do tego teleobiektywy za 199 dolarów i możemy celować na większe odległości.

Być może zastanawiasz się, kim są badacze stojący za tym zaskakującym odkryciem, które pokazuje nowy sposób atakowania szeregu urządzeń, które wszyscy instalujemy w naszych domach. Cóż, rozmawiamy o Takeshi Sugawara z Uniwersytetu Elektrokomunikacji w Japoniioraz Sara Rampazzi, Benjamin Cyr, Daniel Genkin i Kevin Fu z Uniwersytetu Michigan. Innymi słowy, jeśli kiedykolwiek myślałeś, że mówimy o fantazji, wcale nie jest to prawdą.

A nowy atak na urządzenia głosowe Asystenta Google, Siri i Alexy z lekkimi komendami i to będzie miało ogon w nadchodzących latach; Asystent Google integrujący się z WhatsApp, więc wyobraź sobie, co można zrobić z tymi atakami.